En février 2026, la startup américaine Foundation a livré deux unités du Phantom MK-1 en Ukraine — première mise à l’épreuve d’un robot humanoïde sur un front de guerre actif. Conçu pour remplacer le soldat dans les missions les plus exposées, l’engin soulève des questions qui dépassent largement le champ de bataille : qui décide de faire feu, qui répond de ses erreurs, et jusqu’où peut-on déléguer la mort à une machine ?

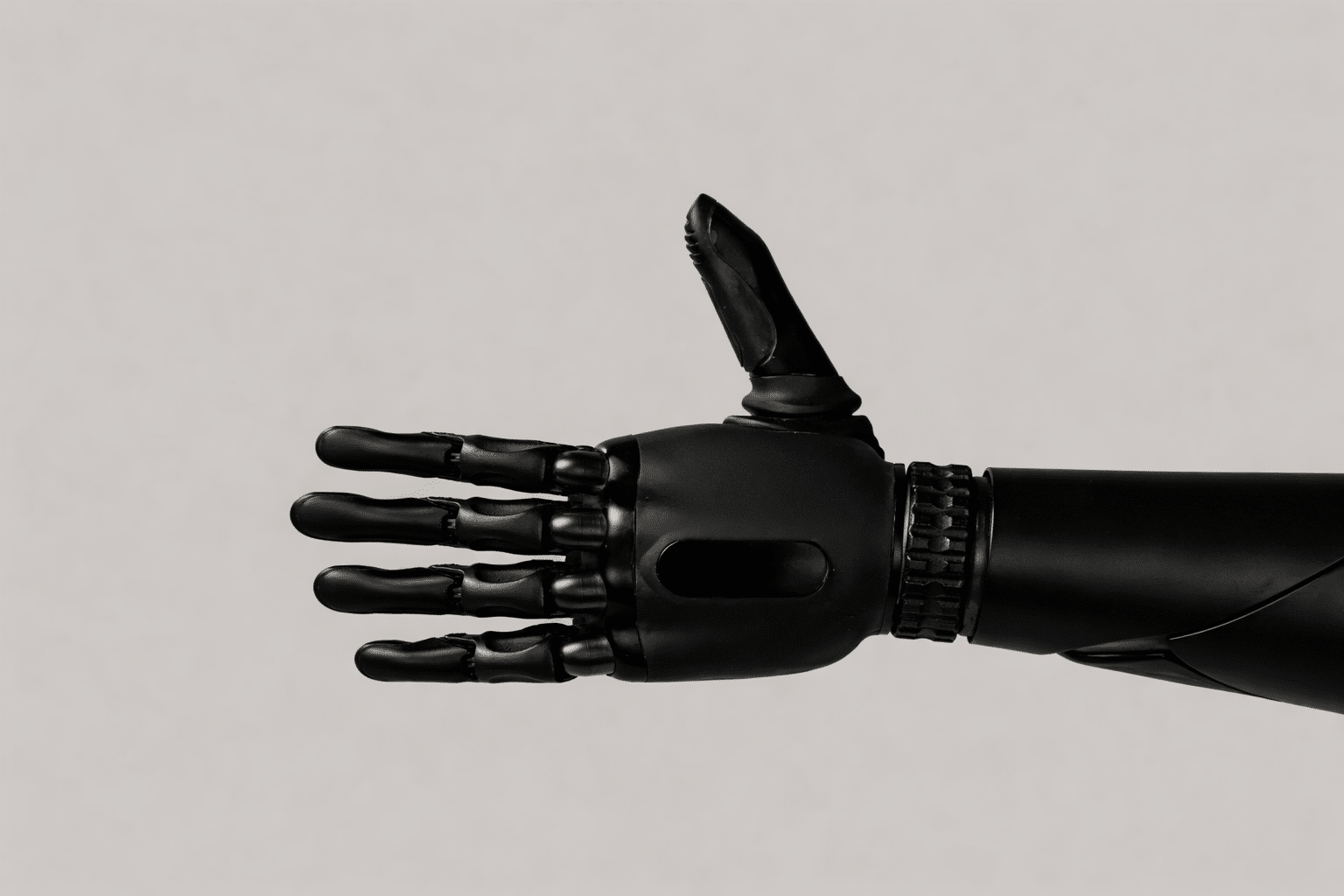

Il ressemble à un soldat. Taille 1,75 m, quelque 80 kg sous armure noire, visière teintée occultant les capteurs optiques qui lui tiennent lieu d’yeux. Lorsqu’il empoigne un fusil M-16, le Phantom MK-1 reproduit la gestuelle d’un combattant humain avec une précision qui, d’après les ingénieurs de Foundation, est précisément son principal atout tactique. En février 2026, deux unités de ce robot ont quitté les installations de la société californienne pour rejoindre le front ukrainien : première occurrence documentée d’un humanoïde déployé sur le front d’un conflit armé actif.

L’information, révélée par le magazine Time le 9 mars, a relancé les débats dans les milieux de la défense et de l’éthique militaire. Non parce qu’elle était totalement imprévisible — les drones autonomes, les véhicules terrestres robotisés ou les systèmes de défense antiaériens automatisés ont depuis longtemps brouillé la frontière entre machine et combattant — mais parce qu’elle franchit une ligne symbolique jusqu’ici intacte : celle du robot qui marche, vise et pourrait tirer à la place de l’homme.

Un laboratoire à ciel ouvert nommé Ukraine

L’Ukraine est devenue, depuis l’invasion russe de février 2022, l’un des terrains d’expérimentation les plus intenses pour les technologies militaires émergentes. Les chiffres qui suivent proviennent du programme gouvernemental ukrainien Brave1 et de l’agence d’État United24 — aucune source indépendante ne les a recoupés à ce stade. Les systèmes robotiques terrestres auraient conduit plus de 7 000 opérations au seul mois de janvier 2026, l’écrasante majorité à des fins logistiques : acheminement de munitions, évacuation de blessés, reconnaissance dans des zones interdites aux véhicules conventionnels. Plus de 200 entreprises ukrainiennes produiraient aujourd’hui des plateformes robotisées.

C’est dans ce contexte d’accélération technologique inédite que Foundation a choisi Kiev pour son baptême du feu. La firme de San Francisco, co-fondée par Mike LeBlanc — vétéran de quatorze ans du Corps des Marines américains, ayant effectué de multiples rotations en Irak et en Afghanistan — a dévoilé le Phantom MK-1 en octobre 2025. L’engin dispose de contrats de recherche d’un montant cumulé de 24 millions de dollars avec l’armée de terre, la marine et l’armée de l’air américaines, faisant de l’entreprise un fournisseur agréé du Pentagone. En Ukraine, l’objectif initial est limité à la reconnaissance de première ligne, dans des environnements — bunkers, boyaux effondrés, bâtiments piégés — où les drones ne peuvent pénétrer.

Ce que la machine peut faire — et ne peut pas encore

Le Phantom s’appuie sur une vingtaine de moteurs commandant chaque articulation. Sa locomotion repose principalement sur des systèmes de vision par caméra, sans LiDAR. Il peut manier des armes légères — pistolets, fusils à pompe, réplique du M-16 — et son concepteur affirme vouloir, à terme, lui faire manipuler “n’importe quelle arme qu’un humain peut tenir“. Sa signature thermique, proche de celle d’un corps humain, pourrait également induire en erreur les capteurs de détection adverses.

Les limites demeurent considérables. Durant la visite des journalistes de Time au siège de la société, l’une des unités s’est effondrée à plusieurs reprises avec fracas. L’autonomie de la batterie est restreinte, le robot est vulnérable à l’humidité et ses 20 moteurs constituent autant de points de défaillance potentielle. La prochaine version, le Phantom MK-2, annoncée par Foundation pour avril 2026, doit corriger plusieurs de ces fragilités selon l’entreprise : étanchéité renforcée, batteries étendues, charge utile portée à 80 kg. La production est planifiée à l’échelle de quelques dizaines d’unités cette année, avec l’ambition affichée par Foundation d’atteindre 50 000 exemplaires annuels d’ici à 2027 — objectif que rien, à ce stade, ne permet de confirmer indépendamment.

La question du déclencheur: qui, ou quoi, décide de tirer ?

C’est ici que le dossier devient véritablement sensible. Les protocoles en vigueur au Pentagone stipulent qu’un système automatisé ne peut engager une cible qu’après autorisation d’un opérateur humain. Foundation déclare se conformer à ce protocole pour le Phantom MK-1. Par ailleurs, l’Ukraine déploie déjà des drones intégrant des capacités d’identification autonome de cibles — sans que le niveau précis de validation humaine requis avant frappe soit toujours documenté publiquement. La frontière entre les deux régimes est, dans le feu de l’action, poreuse.

Les risques liés au piratage ajoutent une dimension supplémentaire. Les drones capturés se sont avérés de précieuses sources de renseignement, fonctionnant comme de véritables smartphones volants. Un robot humanoïde compromis introduirait une menace d’un genre inédit : un ennemi maîtrisant ses failles logicielles pourrait, en théorie, retourner une flotte entière contre ses opérateurs d’origine. Des experts en intelligence artificielle interrogés par Time soulignent l’opacité des grands modèles de langage et jugent inacceptable de confier des décisions létales à des systèmes susceptibles de produire des erreurs — ce que le jargon du secteur nomme des “hallucinations”.

Un vide juridique international qui se creuse

Le cadre normatif international accuse un retard manifeste sur les réalités du terrain. Dès septembre 2023, en marge de la 80e session de l’Assemblée générale des Nations Unies, le Secrétaire général de l’ONU António Guterres et la présidente du Comité international de la Croix-Rouge (CICR) Mirjana Spoljaric avaient lancé un appel conjoint aux États pour négocier, avant 2026, un instrument juridiquement contraignant interdisant ou encadrant strictement les systèmes d’armes autonomes. À ce jour, aucun texte à force obligatoire n’a abouti.

Le CICR rappelle qu’aucune règle spécifique du droit international humanitaire ne vise explicitement les armes autonomes, mais que le droit existant impose aux États d’évaluer la légalité de tout nouveau système avant déploiement. L’institution souligne en particulier que les algorithmes d’apprentissage automatique — “des logiciels foncièrement imprédictibles qui se programment tout seuls“, selon les termes de son appel conjoint avec l’ONU de septembre 2023 — ne sauraient se voir déléguer des décisions de vie ou de mort. La prolifération des plateformes sans équipage, qui s’est accélérée dans tous les théâtres d’opération contemporains, aggrave, de l’avis du CICR, les risques pour les populations civiles et érode les principes fondamentaux de distinction et de proportionnalité.

L'impératif moral, ou la guerre sans corps à ramener

Mike LeBlanc ne cache pas sa conviction. “Nous pensons qu’il y a un impératif moral à envoyer ces robots à la guerre plutôt que des soldats“, déclare-t-il dans l’enquête de l’hebdomadaire américain. La formule est directe, et elle résume une thèse qui circule depuis plusieurs années dans les cercles de la défense et des technologies militaires de pointe : si une machine peut absorber une frappe de missile, désamorcer un bâtiment piégé ou traverser un champ de mines à la place d’un soldat de 22 ans, le bilan humain global s’en trouve réduit.

Ses détracteurs opposent un argument symétrique : réduire le coût humain immédiat pour le camp qui dispose de la technologie pourrait abaisser le seuil politique d’entrée en guerre. Le CICR avait lui-même formulé cette mise en garde dans cet appel conjoint, notant que ces systèmes, “en donnant l’impression que les forces militaires et les civils courent moins de risques, peuvent abaisser le seuil d’engagement dans les conflits, entraînant involontairement une escalade de la violence“. La guerre sans corps à ramener n’est peut-être pas une guerre moins probable — elle pourrait même être une guerre plus facile à déclencher.

Le cofondateur de Foundation projette, lui, une vision à plus long terme : des conflits réduits à une logique d’affrontement entre flottes automatisées — un équilibre économique qui, selon lui, rendrait la guerre moins létale. “Des batailles de droïdes, avec des drones au-dessus et des humanoïdes qui avancent les uns vers les autres, ça devient un conflit économique“, confie-t-il au magazine. “Je pense que c’est tout pour le mieux.” Cette convergence entre la dystopie de science-fiction et le discours de la Silicon Valley mérite d’être prise au sérieux — non comme une prophétie, mais comme un indicateur de la vitesse à laquelle la réalité du combat se reconfigure.